V želji, da bi javnost bolje razumela način moderiranja vsebine in njihovo prizadevanje za oblikovanje pozitivnega okolja na spletu, je Facebook izdal že tretje poročilo o uveljavljanju določenih standardov skupnosti.

Največje družbeno omrežje na svetu, ki šteje kar 2,3 milijarde uporabnikov, se namreč že dalj časa srečuje s pozivi po bolj učinkovitem odstranjevanju ekstremistično naravnanih vsebin. Posledično so začeli potencialno spornim vsebinam posvečati več pozornosti in v zadnjih letih pri iskanju takšnih vsebin postali bolj proaktivni.

V ta namen so začeli pospešeno uporabljati tudi umetno inteligenco, ki deluje na osnovi sistemov prepoznave slik in razumevanja jezika, ter zna samodejno odkriti in tudi odstraniti sporne vsebine. Prav tako pa so v zadnjih letih povečali obseg moderatorjev, ki preverjajo ustreznost objav in komentarjev.

Poročilo Facebooka obravnava več kategorij kršitev, od katerih je ena tudi sovražni govor. Kot navajajo pri Facebooku, sovražni govor oblikuje izključujoče okolje ter v nekaterih primerih celo spodbuja nasilje. Sovražni govor pri Facebooku definirajo kot nasilen govor, izjave o manjvrednosti in pozive k izključenosti oziroma segregaciji na podlagi rase, etnične pripadnosti, narodnosti, verske pripadnosti, spolne usmerjenosti, kaste, spola, spolne identitete in invalidnosti ali bolezni.

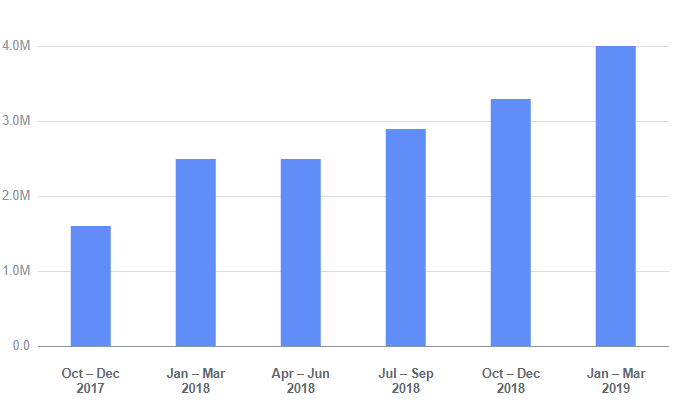

V zadnjem poročilu, ki obsega analizo obdobja od oktobra 2018 do marca 2019, je Facebook v prvem tromesečju (oktober, november, december) ukrepal pri 3,3 milijona primerov, v drugem tromesečju (januar, februar, marec) pa že pri 4 milijonih primerov. Če to primerjamo s prvim meritvenim obdobjem v prvem poročilu (od oktobra do decembra leta 2017), ko je bilo 1,6 milijona takšnih primerov, vidimo precejšnjo porast.

Število primerov sovražnega govora, pri katerih je Facebook ukrepal

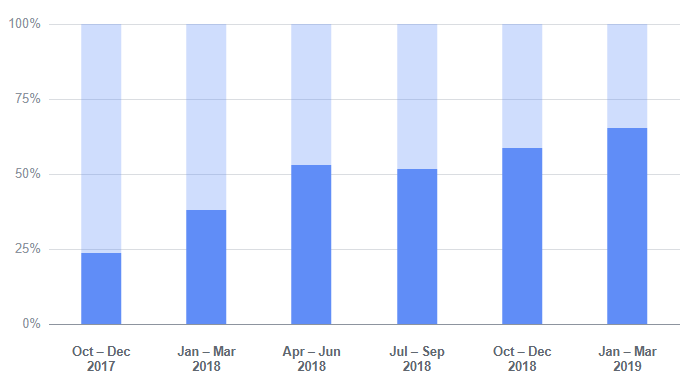

Te številke vključujejo tako primere, ki jih je Facebook odkril proaktivno, kot tudi primere, ki so jih prijavili drugi uporabniki. Pri tem statistični podatki podprejo navedbe Facebooka glede intenzivnejše proaktivnosti. Od prvega meritvenega obdobja konec leta 2017 se je namreč stopnja proaktivnosti Facebooka dvignila iz 23,6 % na 65,4 % v zadnjem meritvenem obdobju v začetku letošnjega leta. Podrobnejša obrazložitev: To pomeni, da je 65,4 % od 4 milijonov primerov sovražnega govora, pri katerih so ukrepali, Facebook odkril sam, še preden jih prijavil kakšen drug uporabnik.

Količina primerov sovražnega govora, ki jih je Facebook našel proaktivno

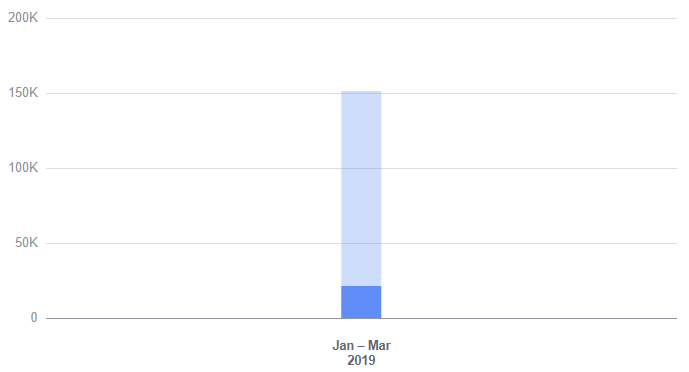

Facebook sicer uporabnikom ponuja tudi možnost pritožbe na odločitev umika vsebine in vsebino tudi postavi nazaj, če uporabnik dokaže, da je bila ta odstranjena neupravičeno. V zadnjem meritvenem obdobju so tako prejeli 1,1 milijona pritožb glede umaknjenih vsebin, od katerih so jih ugodno razrešili 130.000, 21.200 pa vsebin pa so postavili nazaj brez prejetih pritožb.

Število primerov vsebin, ki jih je Facebook po umiku povrnil